HDR (für Englisch High Dynamic Range oder einfach Hochkontrast) ist die nächste Generation, was Farbklarheit und Realismus in Bildern und Videos betrifft. Ideal für Medien, die einen hohen Kontrast erfordern oder Licht mit Schatten vermischen, bewahrt HDR die Klarheit und Schärfe besser als SDR (Standard Dynamic Range).

Jetzt weiterlesen, um mehr über die Technologie hinter HDR zu erfahren.

HD (High Definition), Hochsicherheit, Highspeed – in fast jedem Kontext bedeutet der Begriff „hoch“ oder „high“ eine Anhebung „auf das nächste Level“.

HDR (High Dynamic Range, Hochkontrast) ist dabei keine Ausnahme. Indem der gewohnte Standard-Kontrastumfang von SDR ersetzt wird, hat HDR in den vergangenen Jahren immer mehr Aufsehen erregt.

Es ist sehr wahrscheinlich, dass man schon von der High Dynamic Range (oder Hochkontrast) gehört und diese wird das eigene Bilderlebnis ebenfalls „auf das nächste Level“ angehoben. Da HDR immer noch eine ziemlich neue Technologie ist, sind sich viele Leute noch nicht bewusst, wie sie eigentlich funktioniert.

Also, was ist HDR denn nun genau? Wie unterscheidet es sich von SDR? Warum ist es eine wichtige Technologie?

Um die Antworten auf diese Fragen zu erhalten, sollte man einen Blick auf unseren Ratgeber im Folgenden werfen, der HDR und SDR vergleicht, um herauszufinden, wie HDR funktioniert und warum es sich dabei um eine noch länger andauernde Technologie handelt.

Was ist HDR?

HDR ist eine ausgezeichnete Technik, die Inhalte erfasst, verarbeitet und reproduziert und zwar auf eine Art und Weise, in der die Detailstufen von sowohl den Schatten als auch den Akzenten der Szene erhöht werden. Während HDR in der herkömmlichen Fotografie bereits in der Vergangenheit verwendet wurde, so hat die Technologie nun auch den Sprung auf Smartphones, Fernseher, Bildschirme und weitere Endgeräte geschafft.

Was heißt das also nun für den einzelnen Nutzer? Das heißt, dass Bilder im Gesamten über mehr Details und eine breitere Farbpalette verfügt und dem ähnlicher sieht, was vom menschlichen Auge gesehen wird, zumindest im Vergleich zu Bildern in SDR (Standard Dynamic Range).

Im Sinne dieses Artikels konzentrieren wir uns auf Videoinhalte in HDR. Um die High Dynamic Range (Hochkontrast) zu verstehen, muss zunächst verstanden werden, wie die Standard Dynamic Range funktioniert.

Kontrast- oder Dynamikumfang in Bildern

In den meisten Bildern wird man damit in Kontakt kommen, dass es hellere und dunklere Teile des Bildes gibt und beide Bereiche beinhalten sichtbare Details. Wenn ein Bild überbelichtet ist, so gehen Informationen im helleren Teil des Bildes verloren; genauso gehen in unterbelichteten Bildern Informationen in den dunkleren Teilen des Bildes verloren.

Der Kontrast- oder Dynamikumfang beschreibt die Reichweite der Informationen zwischen dem hellsten und dunkelsten Teil des Bildes, auch als Leuchtkraft des Bildes bekannt ist. Ein Bild mit hohem Kontrast- oder Dynamikumfang ist ein Bild mit einer Mischung aus dunklen und hellen Attributen im selben Bild. Sonnenauf- und -untergänge sind ein gutes Beispiel für Bilder mit einem hohem Dynamik- oder Kontrastumfang.

Der Kontrast- oder Dynamikumfang am Monitor

Wenn ein Monitor über ein niedriges Kontrastverhältnis verfügt oder nicht mit HDR arbeitet, wird man Farben und Details eines Bildes als „abgekappt“ erleben, was dann ein Ergebnis der Anzeigefähigkeiten des Bildschirms ist. Wie wir das schon früher erwähnten, werden sämtliche Informationen, die abgekappt werden, verloren gehen und können deshalb auch nicht gesehen werden. Wenn ein Monitor versucht, ein Bild mit einer sehr breiten Leuchtkraft-Reichweite zu produzieren, wird dieses Problem noch stärker hervorgehoben.

HDR schafft bei diesem Problem Abhilfe, indem die Lichtmenge einer gegebenen Szene berechnet wird und dann mithilfe dieser Information die Details innerhalb des Bildes aufrechterhält und das sogar bei einer großen Vielfalt an Helligkeitsstufen. Dies geschieht als eine Bestrebung, realistischer aussehende Bilder zu schaffen.

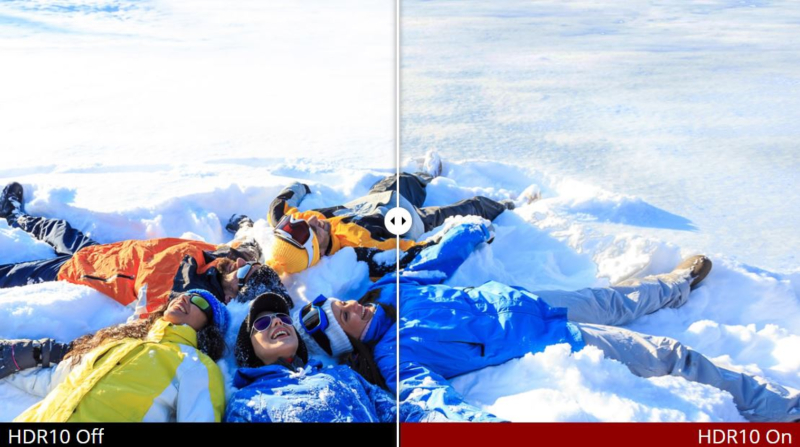

HDR im Vergleich zu SDR

SDR (was für Standard Dynamic Range steht), ist der momentane Standard für Video- und Kinodisplays. Leider ist dieser Standard in seiner Fähigkeit eingeschränkt, nur einen Teil des Dynamik- oder Kontrastumfangs dessen anzuzeigen, wozu HDR in der Lage ist. HDR hingegen erhält Details in Szenen aufrecht, in denen das Kontrastverhältnis des Bildschirms andererseits ein Hindernis darstellen würde. SDR hingegen hat diese Begabung nicht.

Um es in einfachen Worten auszudrücken, erlaubt HDR (im Vergleich zu SDR) es dem Nutzer, mehr Details und Farben in Szenen mit hohem Kontrast- oder Dynamikumfang sehen zu können. Ein weiterer Unterschied zwischen den beiden liegt in den innewohnenden Messwerten.

Für all jene, die mit der Fotografie vertraut sind, kann das Kontrast- oder Dynamikverhältnis in Stopps / Blendenstufen gemessen werden, ähnlich der Blende einer Kamera. Das spiegelt die Anpassungen, die am Gammawert und an der Bittiefe des Bildes vorgenommen wurden, wider und weicht je nachdem, ob HDR oder SDR in Kraft ist, ab.

Auf einem charakteristischen SDR-Display, beispielsweise, werden Bilder einen Kontrastumfang von etwa 6 Blenden aufweisen. Im Gegenzug dazu sind Inhalte in HDR dazu in der Lage, diesen Kontrastumfang fast zu verdreifachen, wobei der Durchschnitt bei 17.6 Blenden liegt. Aufgrund dessen könnte eine dunkle Szene mehr Graufarben aufweisen, die vom Schwarz abgeklammert werden, während die hellen Szenen mehr Farben und Details aufweisen, die vom reinen Weiß getrennt werden.

Welche Faktoren beeinflussen HDR?

Was HDR anbelangt, so gibt es heute zwei bekannte Standards, die derzeit verwendet werden, namentlich Dolby Vision und HDR10. Wir werden uns die Unterschiede zwischen diesen beiden Standards im Folgenden näher ansehen.

Dolby Vision

Dolby Vision ist ein HDR-Standard, der es notwendig macht, dass die verwendeten Bildschirme mit einem eigenen Dolby Vision Hardware-Chip eigens dafür entwickelt worden zu sein, wofür Dolby entsprechende Lizenzgebühren einhebt. Dolby Vision nutzt eine Obergrenze von 12 Bit in der Farbe und 10.000 cd/m² in der Helligkeit. Es ist wichtig, anzumerken, dass der Farbumfang und die Helligkeitsstufe von Dolby Vision über die Einschränkungen des von den modernen, heutzutage produzierten Displays höchstens Erreichbaren hinausgehen. Außerdem ist das Hindernis für Display-Hersteller, Dolby Vision zu integrieren, immer noch sehr hoch, was auf die besonderen Hardware-Unterstützungs-Anforderungen zurückzuführen ist.

HDR10

HDR10 ist ein einfacher annehmbarer Standard und wird von Herstellern als Mittel zur Vermeidung der Integration der Standards und Gebühren von Dolby genutzt. Zum Vergleich, HDR10 nutzt 10 Bit Farbtiefe und kann Inhalte mit bis zu 1.000 cd/m² in der Helligkeit abliefern.

HDR1ß hat sich selbst als die Standardnorm für 4K UHD Blue-Ray-Disks entwickelt und wurde außerdem von Sony und Microsoft in die PlayStation 4 und die Xbox One S integriert. Was die Computerbildschirme betrifft, so sind auch einige Bildschirme aus der Auflistung der besten Gaming-Bildschirme mit Unterstützung für HDR10 ausgestattet.

HDR-Inhalte

Es ist ein einfach zu machender Fehler, besonders dann, wenn man einen HDR-Fernseher besitzt, davon auszugehen, dass alle Inhalte auch tatsächlich HDR sind. Das ist nämlich nicht der Fall: Nicht alle Inhalte wurden auch gleichermaßen geschaffen!

Um ein sachdienliches Beispiel oder besser gesagt einen Vergleich anzuführen: Wenn man einen 4K-Fernseher besitzt, wird man auch nicht in der Lage sein, die Vorteil von hoher Detailtreue in 4K profitieren können, wenn die Inhalte, die man betrachtet, nicht auch tatsächlich 4K sind. Dasselbe trifft auch gleichermaßen auf HDR zu: Um HDR genießen zu können, muss man zunächst auch sicherstellen, dass das betrachtete Material eine derartige Erfahrung auch unterstützt und ermöglichen kann.

Wo findet man also nun HDR-Inhalte?

Derzeit sind Inhalte in HDR auf eine Vielzahl von Möglichkeiten erreichbar und erhältlich. Was das Streaming betrifft, unterstützt beispielsweise Netflix HDR unter Windows 10 und auch Amazon Prime ist kürzlich ebenfalls auf den HDR-Zug aufgesprungen. Wenn es um physischen Content geht, so gibt es Blu-ray-Disks und Blue-Ray-Player, die man neben integrierten Playern der Gaming-Konsolen Sony PlayStation 4 und Microsoft Xbox One S kaufen kann.

Ist das eigene Setup bereit, um HDR anzeigen zu können?

Sobald die gewählten HDR-Inhalte zur Verfügung stehen, ganz egal, ob es sich nun um ein HDR-Video oder ein HDR-Spiel handelt, muss man auch sicherstellen, dass das eigene Setup dazu in der Lage ist, diese HDR-Inhalte auch entsprechend ausgeben und anzeigen zu können.

Der erste Schritt ist die Überprüfung dessen, ob die eigene Grafikkarte HDR unterstützt.

HDR kann über HDMI 2.0 und auch über DisplayPort 1.3 übertragen und entsprechend angezeigt werden. Wenn die eigene Grafikkarte über einen dieser Anschlüsse verfügt, sollte sie in der Regel auch dazu in der Lage sein, HDR-Inhalte zu produzieren und auszugeben. Als einfache Daumenregel lässt sich sagen, dass alle Grafikkarten von Nvidia aus der Reihe der 9xx und neuer, die über einen HDMI 2.0-Anschluss verfügen, HDR unterstützten – dasselbe gilt für alle GPUs von AMD, die ab 2016 produziert wurden.

Was das Display bzw. den Monitor betrifft, so muss man sicherstellen, dass auch dieser HDR unterstützt und dazu in der Lage ist, HDR-Inhalte anzuzeigen. HDR-kompatible Displays müssen zumindest über eine Auflösung von 1080p (Full HD) verfügen. Produkte wie der

ViewSonic VP3268-4K und der VP2785-4K sind Beispiele von 4K-Bildschirmen, die HDR10-Inhalte unterstützen. Diese Bildschirme berücksichtigen auch die Farbtreue in dieser Gleichung, um sicherstellen zu können, dass das Bild am Monitor dann auch so echt und realistisch wie möglich aussieht.

Ist HDR eine gute Investition für die Zukunft?

Im Verlauf der Geschichte eines jeden Mediums veränderte und verändert sich die Norm der Technologie laufen.

In der Musik wurden aus Vinyls und Schallplatten CDs, aus denen dann einfache MP3-Dateien wurden. Was das Betrachten von Filmen zu Hause betrifft, so wurden aus VHS-Kassetten DVDs und aus diesen wiederum Blu-ray-Disks. Sprechen wir von der Auflösung von Fernsehern und Bildschirmen, so wurden aus den einfachen 480i bald 720p und mit der Zeit 1080i. Das Muster sollte klar sein.

Was das letztere Beispiel betrifft, so waren HD-Fernseher (High Definition) bis ins Jahr 1998 nicht in den Vereinigten Staaten von Amerika verfügbar und wurden erst fünf bis acht Jahre danach wirklich beliebt. Heutzutage ist die Full HD-Auflösung eigentlich schon so weit im Land verbreitet, dass 4K UHD als die neue „Randvariante“ fungiert.

Der derzeitige, aktuelle Kampf zwischen HDR und SDR spiegelt denselben Trend wider. Obwohl HDR in der Welt der Fotografie nun schon seit einiger Zeit Gang und Gäbe ist, so ist die Technologie doch der Neue, wenn man von Fernsehern und Bildschirmen spricht. Einige sind sogar so weit gegangen, damit zu argumentieren, dass 1080p HDR besser aussieht, als 4K SDR!

Wenn man mit dem Gedanken spielt, den Sprung zu HDR zu wagen, stellt man sich vielleicht folgende Frage: Ist HDR denn nun wirklich eine gute Investition? Wird die Technologie der High Dynamic Range (Hochkontrast) wirklich derart abheben?

Während natürlich nichts zu 100 % sicher ist, so steht das Glück doch relativ eindeutig auf der Seite der HDR-Technologie: Derzeit ist die eigene Technologie eng mit jener der UHD-Auflösung (Ultra High Definition) verbunden, auch bekannt als 4K.

Da 4K vom allgemeinen Markt mit beachtenswerter Leichtigkeit und Geschwindigkeit angenommen wird, liegt es auf der Hand, dass auch HDR denselben Kurs in naher Zukunft einschlagen wird. Wir können HDR und SDR den ganzen Tag lang vergleichen, schlussendlich muss die Frage, ob HDR denn nun gut oder schlecht ist, von jedem für sich beantwortet werden und hängt ganz von der persönlichen Erfahrung ab.

Zum Glück für alle frühzeitigen Anwender und alle Erstanwender da draußen ist es nicht schwer, an HDR-Produkte zu kommen. Die Vorteile von HDR reichen sogar bis ins Gaming, wo die Technologie es erlaubt, mehr Details in den Spielen sehen zu können und so ein realistischeres Gefühl zu erreichen.

Schreibe einen Kommentar